谷歌开源Gemma 3 270M闪亮上台!

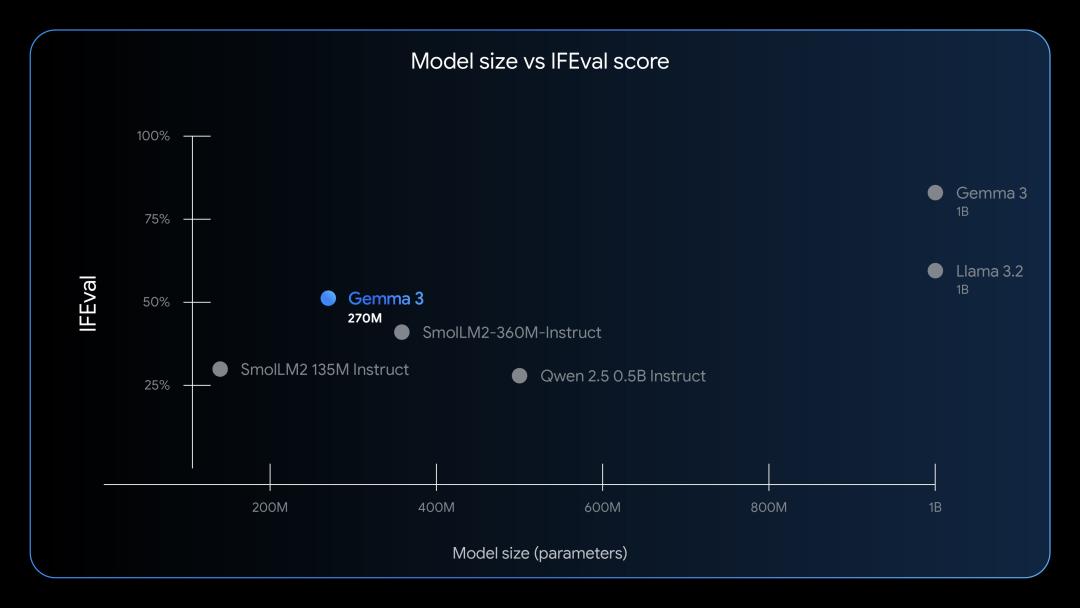

只需几分钟即可完结微调,指令遵从和文本结构化才能更是冷艳,功用逾越Qwen 2.5同级模型。

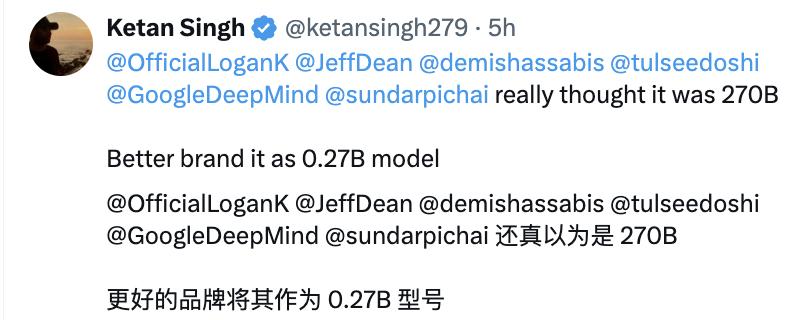

发布当天,网友也懵了:以为是270B,成果竟然才0.27B。

此模型细巧又高效,能够直接在浏览器里本地运转,不必联网,也能生成有构思的内容,比方睡前故事。

不只如此,还有人运用这款迷你模型构建了自己的OCR运用程序。上传一张图片或PDF文件,即可用LLM即时将其转换为结构化的Markdown格局。

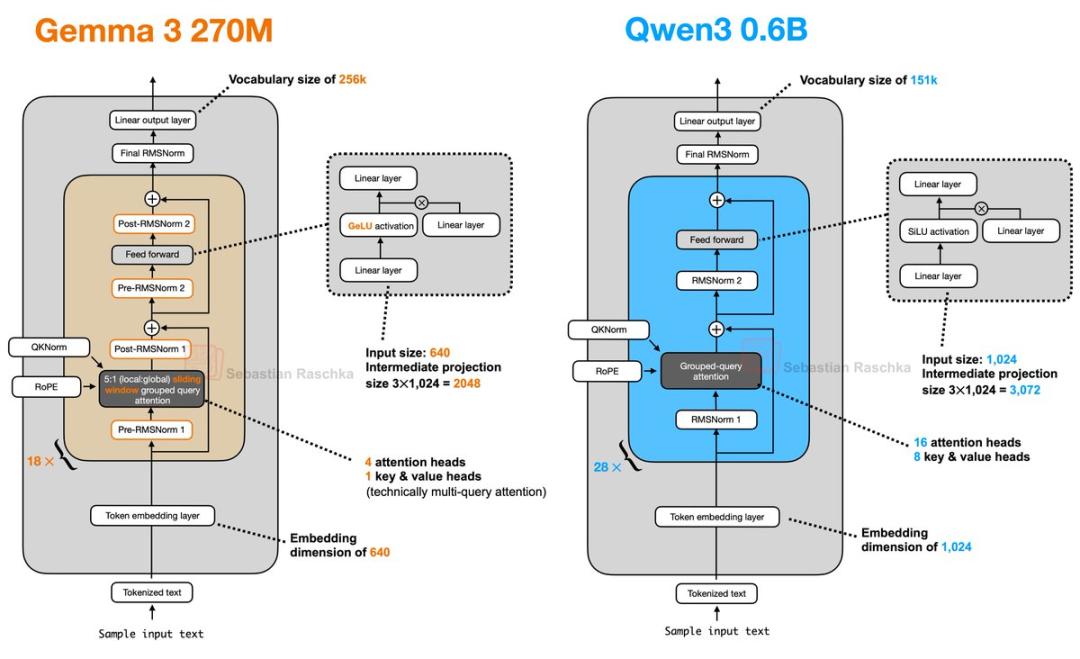

值得一提的是,新模型只要4个注意力头,比Qwen 3 0.6B少12个,真是实在契合其轻量化的定位。

下面让我们一同看看这款迷你Gemma 3到底有哪些亮点?

Gemma 3 270M中心功用

就像你不会用大锤来挂相框,相同的准则也适用于运用人工智能。

Gemma 3 270M充分体现了这种“为作业挑选适宜东西” 的理念。

作为一款根底模型,它开箱即可精准遵从指令,而微调能彻底开释其真实实力。

通过专门优化,它在文本分类、数据提取等使命中,都能做到精确、快速且本钱可控。

简略总结,新模型的中心功用可归纳为以下4部分:

紧凑且高效的架构

这款新模型共包括2.7亿参数,其间1.7亿为嵌入层参数(因为巨大的词汇量),别的1亿为T都&#小仓鼠太郎动漫在线观看24066;甜心少女在线观看动漫ransformer模块参数。3只唐老鸭动漫在线观看

凭仗25.6万token的巨大词汇量,该模型能够处理特定及稀有词汇,因而成为特定范畴和言语中进一步微调的抱负模型。

极致的动力功率

不只如此,该模型的参数规划在终端运转毫无压力。

内部测验标明,在Pixel 9 Pro手机(SoC芯片)上运转INT4量化版时,25轮对话仅耗费0.75%电量,可谓能效最高的Gemma模型。

指令遵从

此次发布包括一个通过指令微调的模型及对应的预练习查看点,开箱即可精准遵从惯例指令。

可用于出产的量化支撑

此模型供给通过量化感知练习(QAT)的查看点,能让模型以INT4精度运转,且功用损耗微乎其微——这一点关于在资源受限设备上布置而言至关重要。

何时挑选迷你版Gemma 3

轻量化模型的强壮威力在实际运用中现已得到了充分体现。

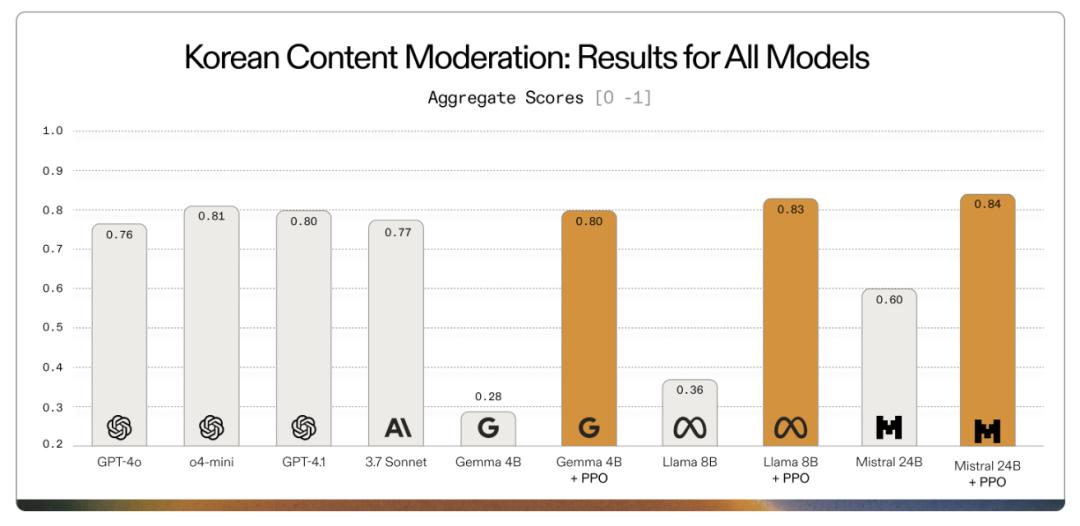

一个典型事例是2025年7月Adaptive ML与SK Telecom的协作,面临杂乱的多言语内容审阅应战,他们挑选了专门化战略:没有运用巨大的通用模型,而是对Gemma 3 4B模型进行了针对性微调。

成果令人冷艳,通过微调的专用Gemma模型不只达到了方针使命的要求,乃至在特定使命上逾越了许多体量更大的专有模型。

Gemma 3 270M旨在让开发者进一步选用这种办法,为清晰界定的使命开释更高的功率。

那么,什么时候合适挑选这款迷你版Gemma 3呢?

1、批量处理专业使命:此模型特别合适处理情感剖析、实体提取、查询路由、非结构化文本转结构化、构思写作及合规性查看等。

2、严格控制呼应时刻和本钱:它能大幅下降乃至消除出产环境中的推理本钱,一起为都市ஶ小仓鼠太郎动漫在线观看0;心3只唐老鸭动漫在线观看少女在线观看动漫用户供给更快速的呼应。

通过微调的270M模型可运转于轻量、低本钱的根底设施,乃至能直接布置在终端设备上。

3、快速迭代和布置:Gemma 3 270M的小模型规划能够完成快速的微调试验,协助你在数小时而非数天内找到合适你用例的完美装备。

4、保证用户隐私 :该模型能够彻底在设备上运转,而无需将数据发送到云端。

5、多使命专业布置:这款迷你模型能帮你在预算范围内,构建并布置多个定制模型,而且每个模型都针对特定使命进行了专业练习。

下面想要快速上手Gemma 3 270M?超简略四步走起。

首要,你能够从Hugging Face、Ollama、Kaggle、LM Studio或Docker获取该模型。

接着用Vertex AI、llama.cpp、Gemma.cpp、LiteRT、Keras和MLX等东西进行测验。

然后运用Hugging Face、UnSloth或JAX等东西进行个性化微调。

最终,你能够将定制好的模型一键布置到本地环境或谷歌Cloud Run等任何环境。

参阅链接:

[1]https://x.com/rasbt/status/1956130338431713307

[2]https://x.com/osanseviero/status/1956024223773663291

[3]https://developers.googleblog.com/en/introducing-gemma-3-270m/

本文来自微信大众号“量子位”,作者:时令 ,36氪经授权发布。